Digital Personal Assistants

На скільки розумні сьогодні голосові помічники

На скільки розумні сьогодні голосові помічники

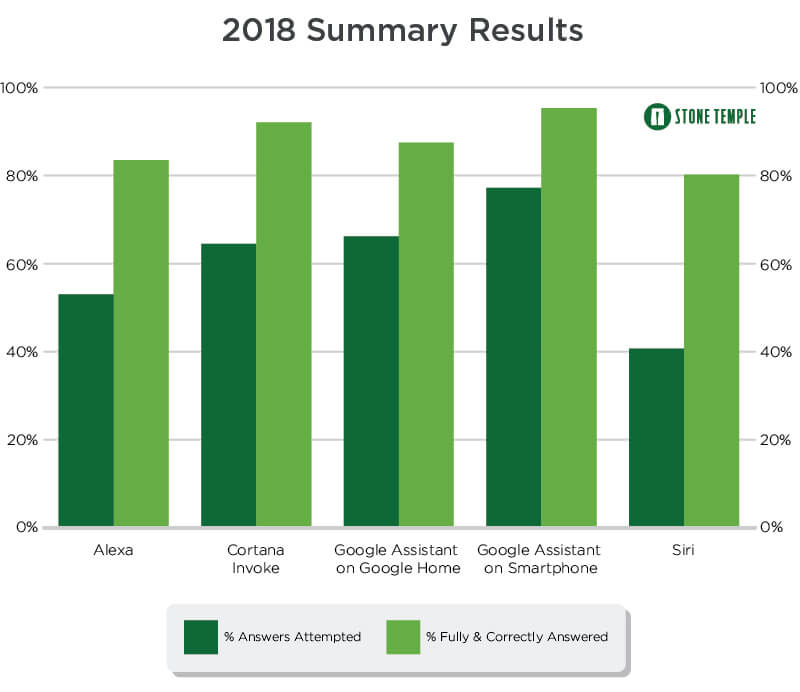

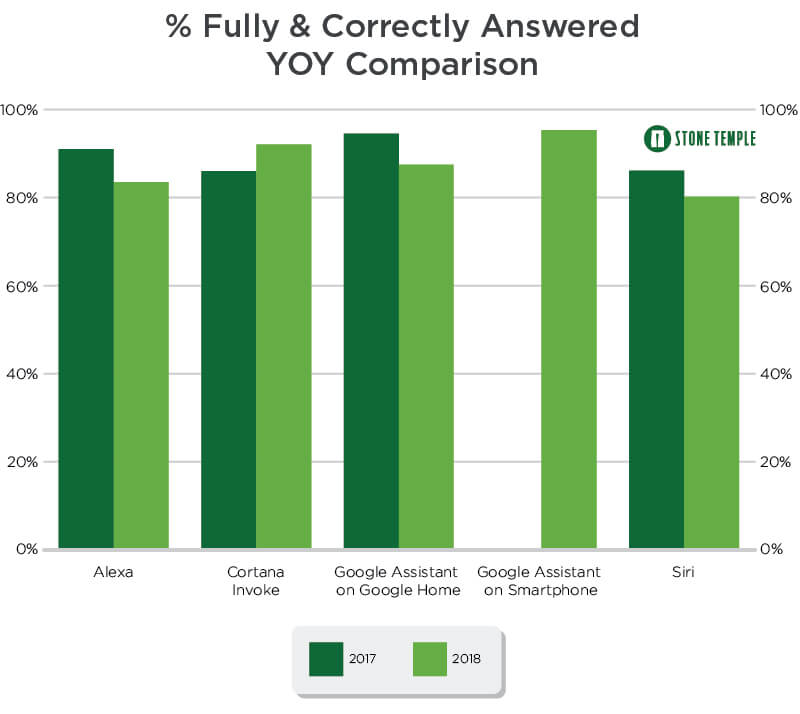

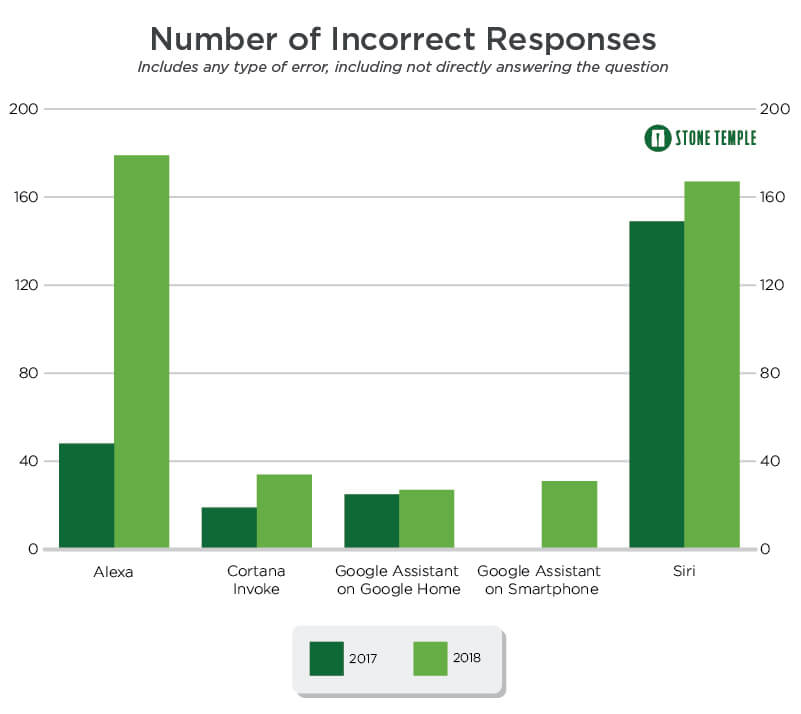

Маркетингове агентство Stone Temple Consulting провело у 2018 році порівняльне дослідження ефективності голосових помічників, які представлені на ринку. Вони порівняли результати дослідження 2018 року з даними 2017 і зробили кілька цікавих висновків.

Digital Personal Assistants — це програмне забезпечення, яке розташоване в хмарних сервісах, призначене для того, щоб допомогти кінцевим користувачам виконувати різні задачі в онлайн режимі. Ці завдання включають відповіді на запитання, керування розкладом дня, керування домашніми пристроями, відтворення музики та багато іншого. Іноді їх називають персональними цифровими помічниками, або просто персональними помічниками; провідними продуктами на ринку є Google Assistant, Amazon Alexa, Siri (від Apple) і Microsoft Cortana.

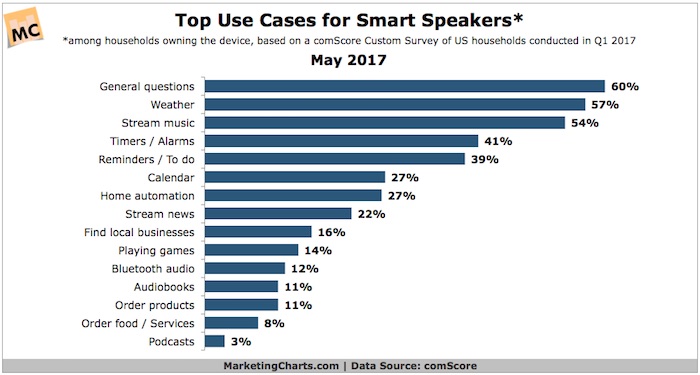

Опитування Comscore показало, що найчастіше користувачі ставлять питання загального характеру.

Stone Temple для дослідження ефективності помічників обрали 4952 запитань, які задали кожному персональному помічнику.

Google Assistant, як і у 2017 році, відповідає на більшість запитань і має найбільший відсоток повних та правильних відповідей. При чому Google Assistant, який є основою смарт-колонки Google Home, дещо відстає від свого смартфонного брата. Другий результат показала Cortana, а помічник Alexa показала найбільше зростання: за рік вона збільшила кількість правильних відповідей у 2,7 раза. В цілому відзначається, що усі помічники значно скоротили розрив із Google у ефективності.

Розглянемо детальніше представлені результати дослідження.

Кожному з п'яти «піддослідних» задали однаковий набір запитань і обрали різні можливі категорії параметрів для оцінки відповідей, зокрема:

Всі чотири особисті помічники включають можливості діяти від імені користувача (бронювання в ресторані, замовлення квітів, бронювання квитків), але ці параметри в дослідження не включались. Основна увага була приділена «розумності» з точки зору знань.

Результати визначались за такими параметрами:

Дослідження Google Assistant на смартфоні у 2017 році не проводилось.

Всі чотири особисті помічники збільшили кількість спроб відповідей, але найбільш значні зміни відбулися в Alexa: цей параметр показав зростання з 19,8% до 53,0%. Cortana Invoke показала друге найбільше зростання спроб відповідей (з 53,9% до 64,5%), на третьому місці Siri (з 31,4% до 40,7%).

Порівняння повноти та точності відповідей

Єдиним помічником, який підвищив свою точність є Cortana Invoke (з 86,0% до 92,1%). Alexa трохи зменшила свої показники ефективності, але у світлі збільшення спроб відповідей у 2.7 раза, це зменшення не є поганим результатом.

Зазначено, що у стовпчику 100% Complete&Correct відповіді повинні бути повні. Як з’ясувалось, існує кілька типів перешкод для цього:

У підсумку, Google Assistant як і раніше відповідає на більшість запитань і має найбільший відсоток правильних відповідей.

Типи помилок, які асистенти роблять найчастіше

Найбільша кількість некоректних відповідей була в Alexa, але варто пам’ятати, що також збільшилась і кількість запитань, на які вона відповіла. Багато «помилок» як в Alexa, так і у Siri з'явилися внаслідок погано структурованих або незрозумілих запитів, наприклад «What movies does The Rushmore, New York appear in?» («У яких фільмах є Рашмор, Нью Йорк?»). Запити такого типу становлять приблизно третину причин некоректних відповідей.

Після детального аналізу невірних відповідей у всіх п'яти випробуваних сценаріях з’ясувалось, що в основному всі помилки були логічними за своїм характером. Іншими словами, коли користувач чує / бачить відповідь, він розуміє, що отримав неправильну відповідь.

Приклади неправильних відповідей

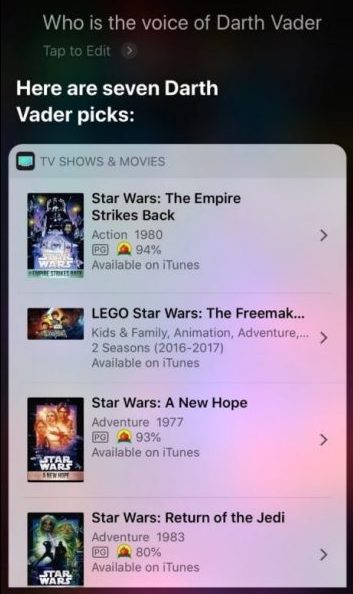

У тесті асистентів попросили відповісти на запитання «Who is the voice of Darth Vader?» («Хто є голосом Дарта Вейдера?»).

Ось як відповідає Siri:

Як видно, Siri відповідає списком фільмів, в яких присутній персонаж Дарта Вейдера. Відповідь релевантна, але не відповідає на запитання користувача.

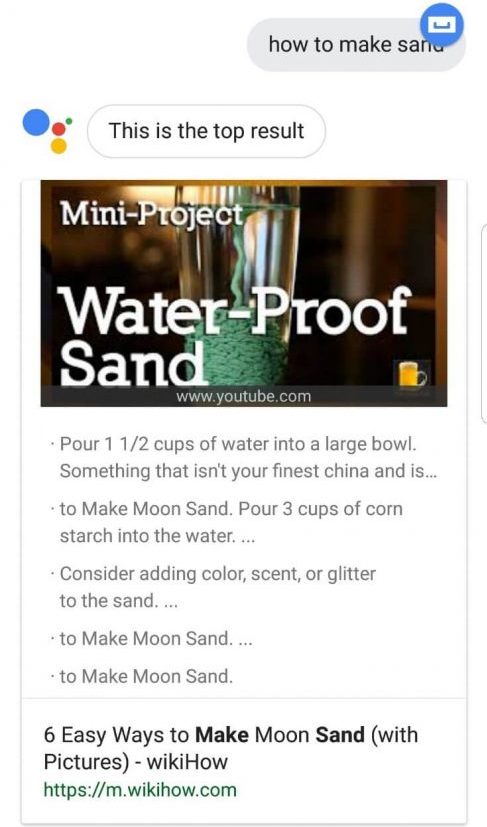

Ось як відповів один з Google помічників на запитання «Як зробити пісок?»

Якщо ви хочете зробити щось подібне до піску для дитячих ігор, це буде цілком правильною відповіддю.

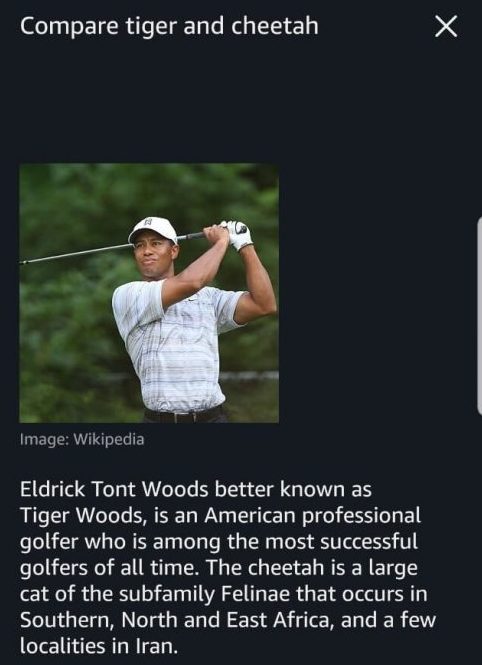

У Alexa видається помилкова відповідь на запит «compare tiger and cheetah» («порівняй тигра і гепарда»).

Відповідь Cortana на запит «Is Joe Biden divorced??» («Чи розлучений Джо Байден?»):

Асистент в цілому зрозумів тему запиту, але питання не зовсім про його доньку.

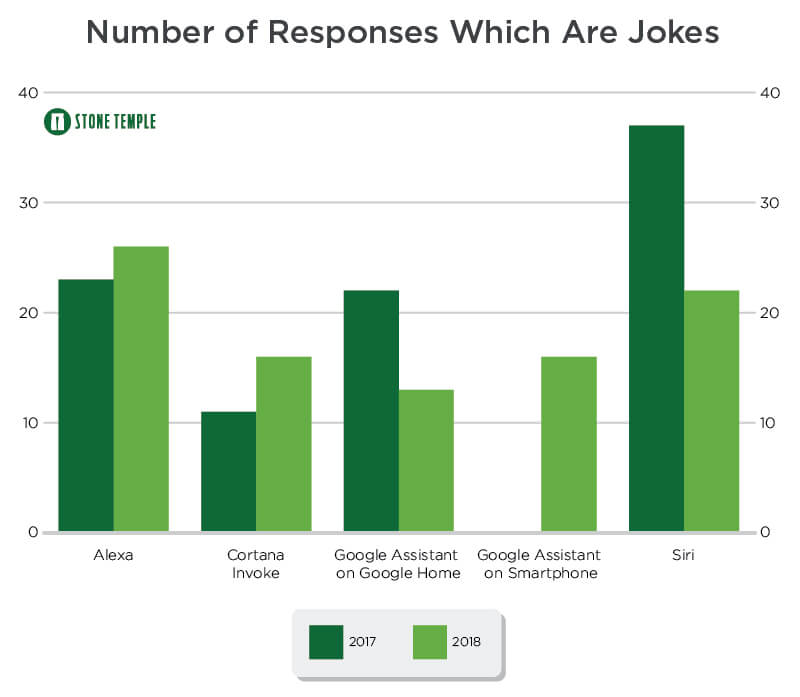

Цікавим параметром, який розглядали дослідники Stone Temple, була дотепність асистентів. Кожен із помічників може пожартувати у відповідь на ваше запитання. З 4942 запитань жартівливу відповідь отримали на таку кількість запитів:

Включення жартів в діалог користувача та асистента є дуже важливим, оскільки часто користувачі ставлять підступні, жартівливі запитання. Також ці жарти додають індивідуальності асистентам.

Ефективність персональних помічників зростає пропорційно до зростання їх популярності серед користувачів, і навпаки. Конкуренція серед представлених на ринку продуктів збільшується. Google Assistant залишається найефективнішим помічником, водночас інші додатки значно скоротили відставання. Очікується, що можливості асистента будуть розширюватись шляхом навчання та взаємодії з більшою кількістю додатків та керування ними.